VoiceChanger : Conversion vocale en temps réel open-source

VoiceChanger : Conversion vocale en temps réel open-source

La demande de manipulation de voix en temps réel a explosé — les streamers souhaitent ressembler à un personnage, les développeurs veulent des mods vocaux en jeu, et les chercheurs ont besoin d’une plateforme flexible pour tester de nouveaux modèles. VoiceChanger (repo : w-okada/voice-changer) répond à cette demande grâce à une solution complètement open-source, multiplateforme, qui prend en charge une variété de modèles de conversion vocale IA, un déploiement Docker et une opération basée sur le réseau.

Pourquoi VoiceChanger ?

- Prise en charge multi-modèles – Beatrice v2, RVC, MMVC, so‑vits‑svc, DDSP‑SVC et plus.

- Multiplateforme – Windows (x86‑64 & M1), macOS, Linux (x86‑64 & aarch64), et Google Colab.

- Performance en temps réel – Pipelines audio à faible latence adaptées aux jeux en direct et au streaming.

- Docker & CLI – Conteneurs à un clic ou utilisation en ligne de commande pour les développeurs.

- Mode réseau – Déléguez le traitement à un serveur distant afin de libérer les ressources de votre jeu.

Aperçu de l'installation

1. Cloner le dépôt

git clone https://github.com/w-okada/voice-changer.git

cd voice-changer

2. Installation des dépendances

VoiceChanger est écrit en Python avec un petit composant TypeScript/Node pour l’interface utilisateur. Le moyen le plus simple est via Docker :

./start_docker.sh # Démarre le conteneur VCClient

Ou bien installez manuellement sur un système avec pip et npm :

pip install -r requirements.txt # Dépendances Python

npm install # Frontend Node

Astuce – Si vous utilisez une machine ARM (par ex. Apple M1), utilisez l’image Docker

std_macou construisez localement avec le drapeau--platform linux/arm64.

3. Télécharger les modèles

Allez dans la section *Downloads du dépôt ou récupérez depuis Hugging Face.*

- Beatrice v2 –

https://huggingface.co/models/beatrice-v2 - RVC –

https://huggingface.co/models/realvision‑rvc

Placez les fichiers de modèle dans

models/et lancez l’interface.

Exécution du client

python client/main.py

L’interface graphique apparaîtra, proposant :

- Sélection de voix – Téléchargez des audios enregistrés par l’utilisateur ou activez le micro.

- Sélection de modèle – Choisissez le modèle et la configuration souhaités.

- Curseurs de paramètres – Hauteur, formant, taille de bloc, et plus encore.

- Touches rapides – Basculer rapidement entre les modes de streaming.

Approfondissement Docker

Pour les serveurs sans tête ou les pipelines CI, Docker est la solution. Le dépôt fournit trois images prêtes à l’emploi :

| Image | Architecture | Modèles pris en charge |

|---|---|---|

vcclient:std_win |

x86‑64 | Beatrice |

vcclient:cuda |

GPU NVIDIA | Beatrice, RVC |

vcclient:onnx |

Tous | Beatrice, RVC |

docker run -it --rm \

-p 5000:5000 \

-v $(pwd)/models:/app/models \

vcclient:onnx

Ceci expose une API REST sur le port 5000 — vous pouvez contrôler le modèle via curl ou tout client HTTP.

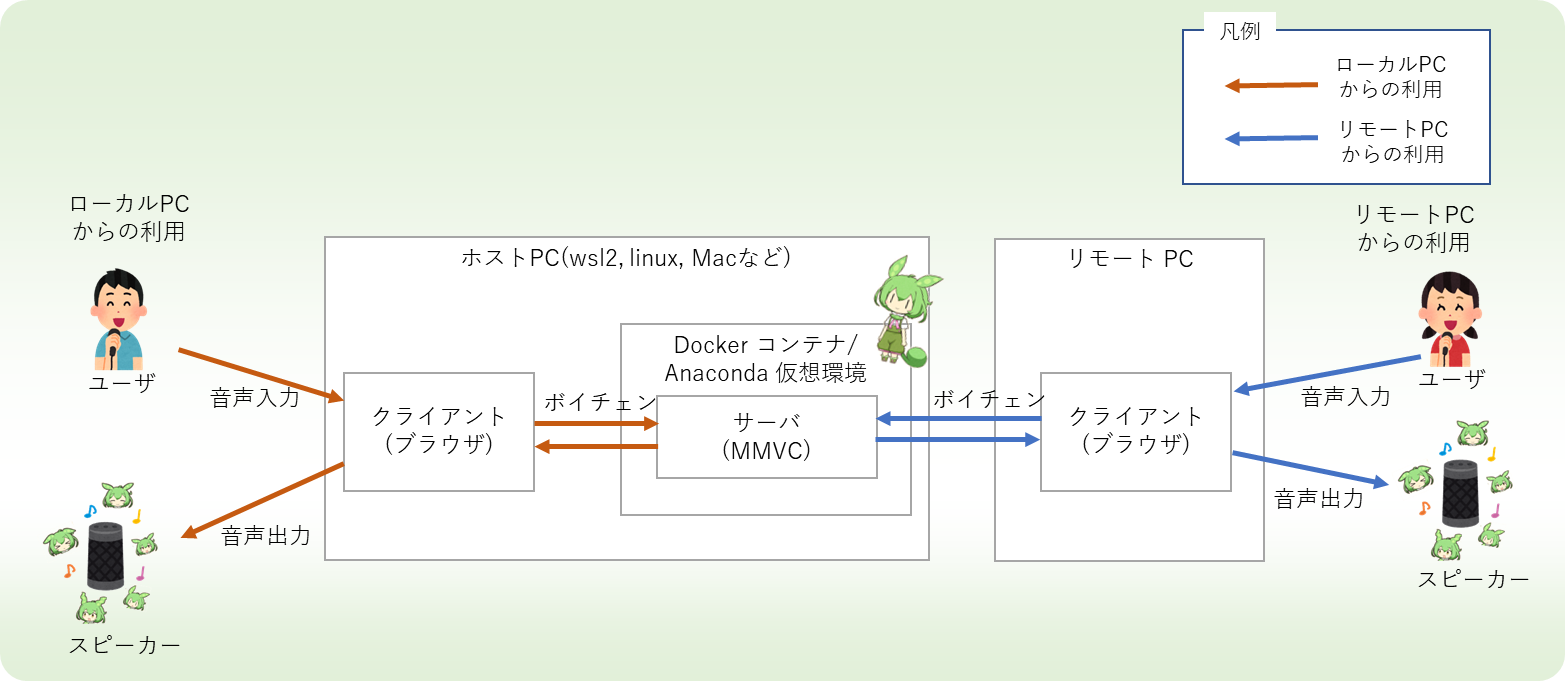

Mode réseau & décharge

Exécuter le client en local peut consommer des ressources GPU que vous préféreriez réserver à un jeu. Le Mode réseau résout ce problème :

- Démarrez le serveur distant (conteneur Docker sur une machine plus puissante).

- Ouvrez le client et sélectionnez Mode serveur.

- Le client transmet l’audio brut au serveur via WebSockets, reçoit la conversion et la joue instantanément.

L’interface inclut un contrôle Origin Check pour éviter les attaques par domaine mixte, et elle enregistre des statistiques de latence afin que vous puissiez ajuster les tailles de buffer.

Tutoriels & Guides

Le dépôt héberge des notebooks Jupyter et des démonstrations Colab :

- Configuration Linux AMD – Adapte la configuration des pilotes GPU.

- VoiceChanger en temps réel sur Colab – Lancez la conversion vocale dans le cloud.

- Notebook Colab avec jeux de données Kaggle – Expérimentez rapidement avec des échantillons vocaux publics.

Tous les notebooks se trouvent dans le dossier tutorials/ et sont conçus pour fonctionner avec un minimum de configuration.

Contribution

N'hésitez pas à forker, ouvrir des PR ou créer des tickets.

Domaines clés de contribution :

- Intégration de modèles – Ajouter la prise en charge de nouveaux modèles SVCC ou SOTA.

- Polish de l’interface – Améliorer l’expérience utilisateur pour les non‑techniques.

- Améliorations Docker – Builds multi‑étapes, couches optimisées GPU.

- Documentation – Traduire la documentation dans d’autres langues.

Le dépôt respecte la licence LICENSE (MIT) et LICENSE-CLA — les contributeurs doivent signer le CLA.

Communauté & Support

- Discord officiel : voice‑changer‑community

- Slack : ai‑voice‑conversion

- Discussions régulières lors de la conférence AI Audio 2026.

Si vous rencontrez des problèmes, commencez par consulter les Issues existants sur GitHub. Recherchez les balises [docker] ou [model‑issue] ; de nombreuses solutions sont déjà documentées.

Conclusion

VoiceChanger transforme le rêve d’un amateur enthousiaste — parler avec n’importe quelle voix — en réalité grâce à une base solide et open-source. Que vous soyez streamer, développeur de mods en jeu, ou simplement en phase d’expérimentation, la combinaison de Docker, du mode réseau et d’un vaste écosystème de modèles fait de cet outil la référence pour la conversion vocale en temps réel.

Prêt à essayer ? Visitez le repo GitHub pour télécharger, compiler et commencer à parler dans la voix de votre choix dès aujourd’hui.