VoiceChanger: Conversión de Voz en Tiempo Real de Código Abierto

VoiceChanger: Conversión de Voz en Tiempo Real de Código Abierto

La demanda de manipulación de voz en tiempo real se ha disparado—los streamers quieren sonar como un personaje, los desarrolladores quieren mods de voz en el juego y los investigadores necesitan una plataforma flexible para probar nuevos modelos. VoiceChanger (repo: w-okada/voice-changer) satisface esta demanda ofreciendo una solución completamente de código abierto y multiplataforma que admite una variedad de modelos de conversión de voz IA, despliegue con Docker y operación basada en red.

¿Por qué VoiceChanger?

- Soporte mult_modelo – Beatrice v2, RVC, MMVC, so‑vits‑svc, DDSP‑SVC y más.

- Multiplataforma – Windows (x86‑64 & M1), macOS, Linux (x86‑64 & aarch64) y Google Colab.

- Rendimiento en tiempo real – Pipelines de audio de baja latencia adecuados para juegos en vivo y streaming.

- Docker y CLI – Contenedores de un clic o uso por línea de comandos para desarrolladores.

- Modo Red – Desplaza el procesamiento a un servidor remoto para mantener libres los recursos de tu juego.

Panorama de la Instalación

1. Clonar el Repositorio

git clone https://github.com/w-okada/voice-changer.git

cd voice-changer

2. Instalación de Dependencias

VoiceChanger está escrito en Python con un pequeño componente TypeScript/Node para la UI. La forma más sencilla es a través de Docker:

./start_docker.sh # Inicia el contenedor VCClient

O instala manualmente en un sistema con pip y npm:

pip install -r requirements.txt # Dependencias de Python

npm install # Frontend de Node

Tip – Si estás en una máquina ARM (p. ej., Apple M1), usa la imagen Docker

std_maco construye localmente con la bandera--platform linux/arm64.

3. Descargar Modelos

-

Dirígete a la sección Downloads del repositorio o descarga desde Hugging Face.

-

Beatrice v2 –

https://huggingface.co/models/beatrice-v2 - RVC –

https://huggingface.co/models/realvision‑rvc

Coloca los archivos del modelo en

models/y lanza la UI.

Ejecutar el Cliente

python client/main.py

La GUI aparecerá, ofreciendo:

- Selección de voz – Sube audios grabados por el usuario o habilita el micrófono.

- Selección de modelo – Escoge el modelo deseado y la configuración.

- Deslizadores de parámetros – Pitch, formante, tamaño de bloque y más.

- Atajos – Alternancias rápidas para modos de streaming.

Exploración Profunda de Docker

Para servidores sin cabeza o líneas de CI, Docker es la solución. El repo incluye tres imágenes listas para ejecutar:

| Imagen | Arquitectura | Modelos soportados |

|---|---|---|

vcclient:std_win |

x86‑64 | Beatrice |

vcclient:cuda |

NVIDIA GPU | Beatrice, RVC |

vcclient:onnx |

Cualquiera | Beatrice, RVC |

docker run -it --rm \

-p 5000:5000 \

-v $(pwd)/models:/app/models \

vcclient:onnx

Esto expone una API REST en el puerto 5000—you puedes controlar el modelo vía curl o cualquier cliente HTTP.

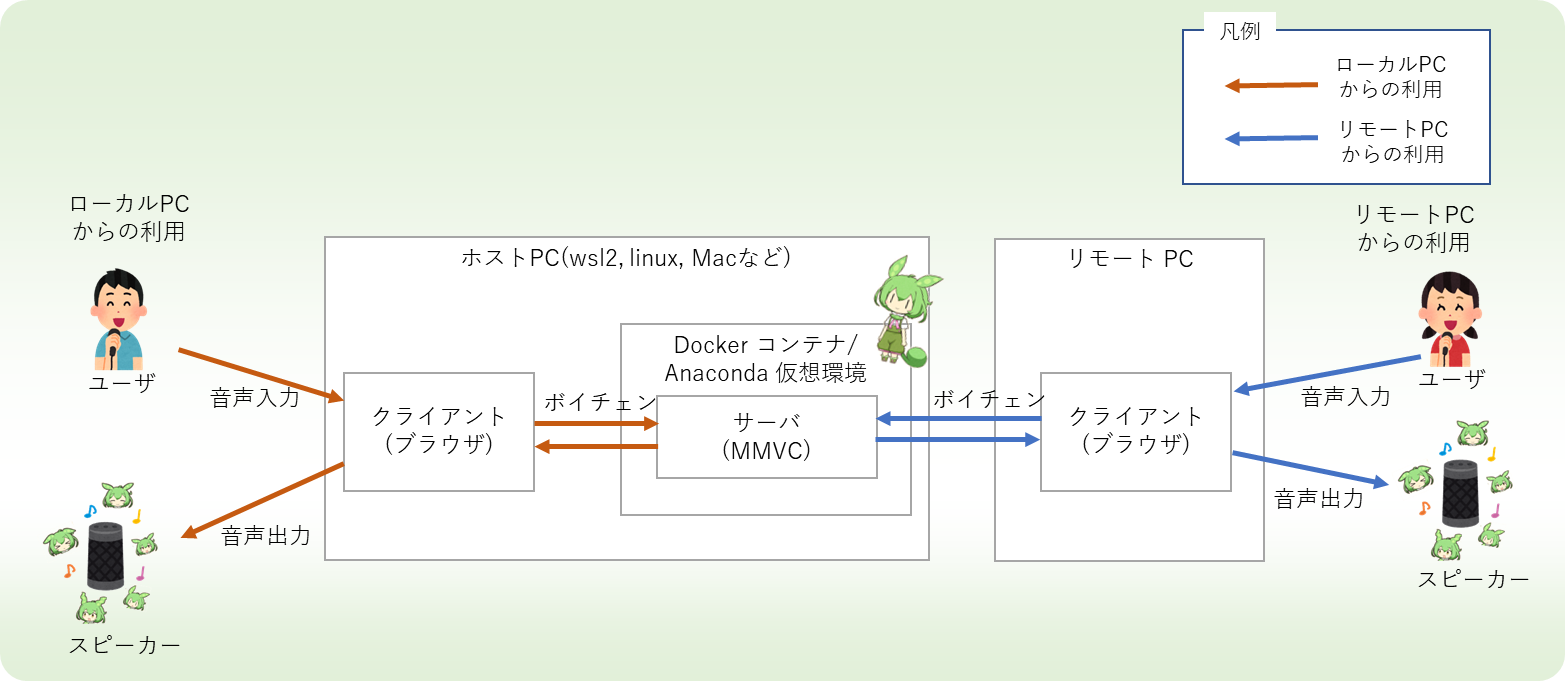

Modo Red y Despliegue

Ejecutar el cliente localmente puede consumir recursos GPU que prefieras reservar para un juego. Modo Red lo soluciona:

- Inicia el servidor remoto (contenedor Docker en una máquina más potente).

- Abre el cliente y selecciona Modo Servidor.

- El cliente transmite audio sin procesar al servidor vía WebSockets, recibe el resultado convertido y lo reproduce al instante.

La UI incluye una Verificación de Origen para prevenir ataques de dominio cruzado, y registra estadísticas de latencia para ajustar los tamaños de buffer.

Tutoriales y Guías

El repo aloja notebooks de Jupyter y demos en Colab:

- Configuración de Linux AMD – Adapta la configuración del controlador GPU.

- VoiceChanger en tiempo real en Colab – Ejecuta la conversión de voz en la nube.

- Notebook de Colab con Kaggle Datasets – Experimento rápido con muestras de voz públicas.

Todos los notebooks están en la carpeta tutorials/ y están diseñados para ejecutarse con mínima configuración.

Contribuciones

Siéntete libre de bifurcar, abrir PRs o crear issues.

Áreas Clave de Contribución:

- Integración de modelos – Añade soporte para nuevos modelos SVCC o SOTA.

- Pulido de UI – Mejora la experiencia de usuario para no técnicos.

- Mejoras de Docker – Construcciones multietapa, capas optimizadas para GPU.

- Documentación – Traduce la documentación a otros idiomas.

El repo sigue la LICENSE (MIT) y LICENSE-CLA – los colaboradores deben firmar el CLA.

Comunidad y Soporte

- Discord oficial: voice-changer-community

- Slack: ai-voice-conversion

- Charlas regulares en la conferencia AI Audio 2026.

Si encuentras problemas, comienza revisando los Issues existentes en GitHub. Busca las etiquetas [docker] o [model‑issue]; muchas soluciones ya están documentadas.

Conclusión

VoiceChanger convierte el sueño entusiasta de un aficionado—hablar con cualquier voz—en realidad con una base sólida y de código abierto. Ya sea que hagas streaming, desarrolles mods de juego o simplemente experimentes, la combinación de Docker, modo red y un amplio ecosistema de modelos lo convierte en la herramienta de referencia para la conversión de voz en tiempo real.

¿Listo para probar? Visita el repositorio de GitHub para descargar, construir y comenzar a hablar con la voz de tu elección hoy mismo.