VoiceChanger:オープンソースのリアルタイム音声変換

VoiceChanger:オープンソースのリアルタイム音声変換

リアルタイム音声操作の需要は急増しています―ストリーマーはキャラクターのように話したい、開発者はゲーム内ボイスモッドを求め、研究者は新モデルをテストできる柔軟なプラットフォームを必要としています。VoiceChanger(リポジトリ:w-okada/voice-changer)は、完全オープンソースのクロスプラットフォームソリューションで、多種多様なAI音声変換モデル、Dockerデプロイ、ネットワーク駆動操作をサポートし、この需要に応えます。

VoiceChanger を選ぶ理由

- 複数モデルサポート – Beatrice v2、RVC、MMVC、so‑vits‑svc、DDSP‑SVC など。

- クロスプラットフォーム – Windows(x86‑64 & M1)、macOS、Linux(x86‑64 & aarch64)、Google Colab。

- リアルタイム性能 – ライブゲームやストリーミングに適した低遅延のオーディオパイプライン。

- Docker & CLI – 開発者向けにワンクリックでコンテナ起動、またはコマンドライン操作が可能。

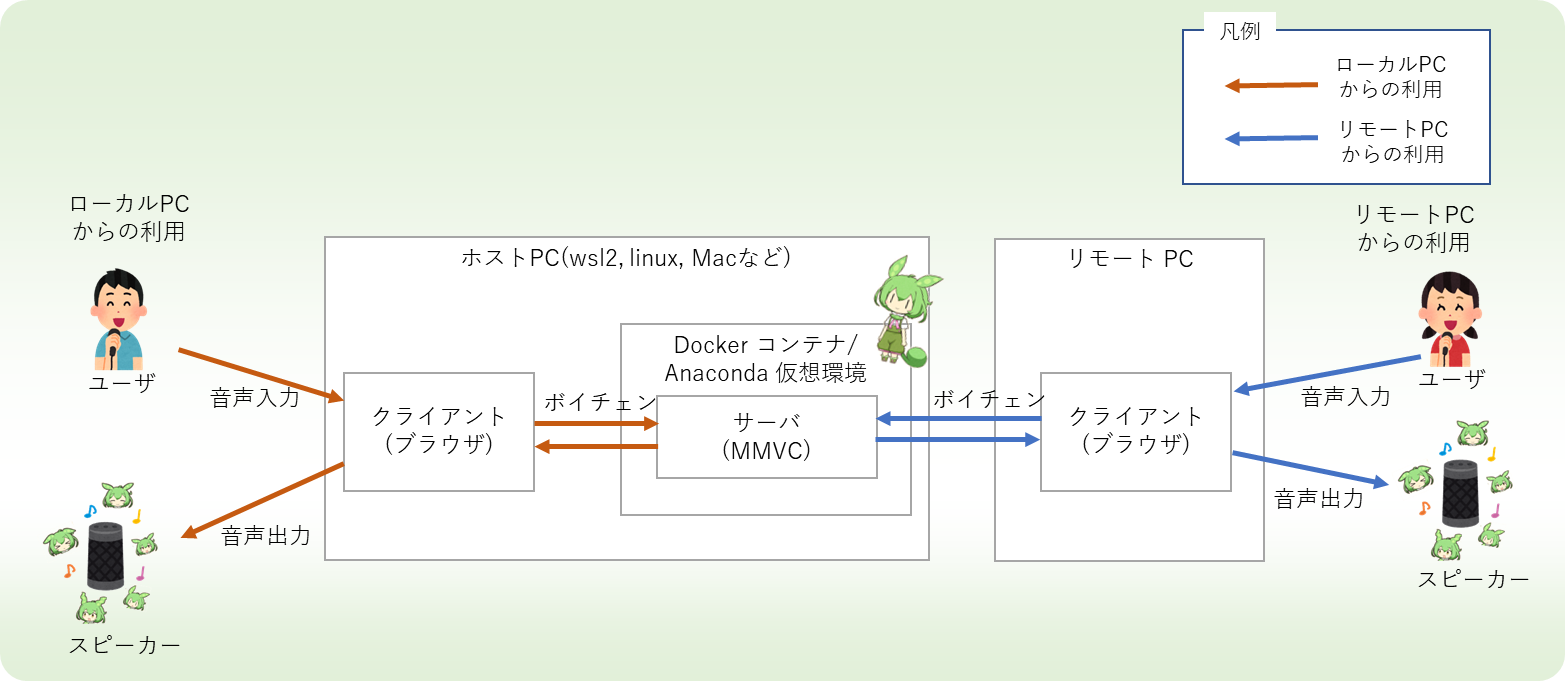

- ネットワークモード – 処理をリモートサーバーにオフロードし、ゲームプレイに必要なリソースを解放。

インストール概要

1. リポジトリのクローン

git clone https://github.com/w-okada/voice-changer.git

cd voice-changer

2. 依存関係のインストール

VoiceChanger は Python で書かれ、UI 用に小規模な TypeScript/Node コンポーネントがあります。最も簡単な方法は Docker 経由です:

./start_docker.sh # VCClient コンテナを起動

または pip と npm を備えたシステムで手動でインストールする場合:

pip install -r requirements.txt # Python 依存

npm install # Node フロントエンド

ヒント – ARMマシン(例:Apple M1)にいる場合は std_mac Docker イメージを使用するか、--platform linux/arm64 フラグを付けてローカルビルドしてください。

3. モデルのダウンロード

リポジトリの「Downloads」セクションにアクセスするか、Hugging Face から取得してください。

- Beatrice v2 – https://huggingface.co/models/beatrice-v2

- RVC – https://huggingface.co/models/realvision‑rvc

モデルファイルを models/ ディレクトリに配置し、UI を起動してください。

クライアントの実行

python client/main.py

Docker 深部解析

ヘッドレスサーバーやCIパイプライン用には Docker が最適です。リポジトリには実行可能な 3 つのイメージが用意されています:

| Image | Architecture | Supported Models |

|---|---|---|

vcclient:std_win |

x86‑64 | Beatrice |

vcclient:cuda |

NVIDIA GPU | Beatrice, RVC |

vcclient:onnx |

Any | Beatrice, RVC |

docker run -it --rm \

-p 5000:5000 \

-v $(pwd)/models:/app/models \

vcclient:onnx

これにより、ポート 5000 で REST API が公開されます。curl やその他 HTTP クライアントでモデルを制御できます。

ネットワークモードとオフロード

ローカルでクライアントを走らせると、ゲームに使いたい GPU リソースを占有することがあります。ネットワークモードで解決します: 1. リモートサーバーを起動(より強力なマシン上で Docker コンテナを起動) 2. クライアントを開き、サーバーモードを選択 3. クライアントが WebSockets 経由で生音声をサーバーへ送信し、変換出力を受け取り即時再生します。

UI にはマルチドメイン攻撃を防止する Origin Check があり、遅延統計も記録してバッファサイズを微調整可能です。

チュートリアルとガイド

リポジトリには Jupyter ノートブックと Colab デモが用意されています: - AMD Linux セットアップ – GPU ドライバ設定を適応します。 - Colab でリアルタイム音声チェンジャー – クラウド上で音声変換を実行します。 - Kaggle データセットと Colab ノートブック – 公開音声サンプルで簡易実験。

全てのノートブックは tutorials/ フォルダー内にあり、最小限のセットアップで実行できるよう設計されています。

コントリビューション

フォーク、プルリクエスト、または issue を自由に作成してください。

主要貢献領域: 1. モデル統合 – 新しい SVCC や SOTA モデルへのサポート追加。 2. UI 改善 – 非技術者向け UX を向上。 3. Docker 改善 – マルチステージビルド、GPU 最適化レイヤー。 4. ドキュメント – ほか言語への翻訳。

リポジトリは LICENSE(MIT)と LICENSE-CLA を採用しており、コントリビューターは CLA に署名する必要があります。

コミュニティとサポート

公式 Discord:voice‑changer‑community Slack:ai‑voice‑conversion AI Audio 2026 会議での定期トーク。

問題が生じた場合はまず GitHub の既存 Issues を確認してください。[docker] や [model‑issue] タグで検索すると、多くの解決策がすでに記録されています。

結論

VoiceChanger は、熱心なハビリテーションの夢―任意の声で話す―を、堅固なオープンソース基盤で実現します。ストリーミング、ゲーム内モッド開発、あるいは単に実験を行うだけでも、Docker、ネットワークモード、充実したモデルエコシステムの組み合わせが、リアルタイム音声変換の最適なツールとなります。

ぜひお試しください。 GitHub リポジトリ へアクセスして、ダウンロード、ビルド、好きな声で話し始めましょう。